AI加速卡是什么?一文拆解 人工智能背后的“速度密码”!

在人工智能技术迅猛发展的今天,无论是语音识别、图像处理还是自动驾驶,背后都离不开强大的计算能力支撑。而传统的中央处理器(CPU)在处理这些海量、并行且高度复杂的AI任务时,往往显得力不从心。这时,一种名为“AI加速卡”的专用硬件便应运而生,成为了驱动人工智能时代前进的关键引擎。本文将深入解析AI加速卡的原理、作用及其与计算机软件开发的紧密联系。

一、AI加速卡的定义与核心原理

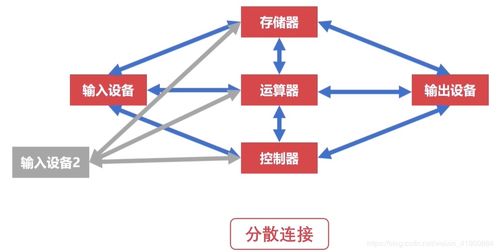

AI加速卡,通常指的是为加速人工智能计算任务而专门设计的硬件加速器,最常见的形式是图形处理器(GPU),也包括专门为AI设计的张量处理单元(TPU)、神经网络处理器(NPU)等。其核心原理在于其架构与CPU的“通用”性不同,它采用了“专用”或“大规模并行”的设计思路。

- 并行计算能力:AI计算,尤其是深度学习中的矩阵乘法和卷积运算,天然具有高度的并行性。一颗CPU仅有少数几个高性能核心,擅长处理复杂的串行逻辑。而一颗AI加速卡(如高端GPU)则集成了数千乃至上万个更简单、更节能的核心,能够同时处理海量数据,在AI训练和推理任务上实现数十倍甚至数百倍的性能提升。

- 高带宽内存:AI模型参数和训练数据量极其庞大。AI加速卡通常配备专用的高带宽内存(如HBM),确保数据能够以极高的速度喂给计算核心,避免因数据等待(“内存墙”)造成的性能瓶颈。

- 专用指令集与硬件单元:现代的AI加速卡内置了针对张量运算的专用硬件单元(如NVIDIA的Tensor Core),能够以极高的效率和精度执行混合精度计算,进一步释放性能潜力。

二、AI加速卡在AI工作流中的关键作用

AI加速卡主要赋能于人工智能的两个核心阶段:训练(Training) 和 推理(Inference)。

- 模型训练:这是最耗计算资源的阶段。研究人员需要利用海量数据,通过复杂的算法反复调整神经网络中数以亿计的参数。这个过程需要巨量的浮点计算。AI加速卡的并行计算能力能够将原本需要数周甚至数月的训练时间缩短到几天或几小时,极大地加速了AI模型的迭代和创新周期。

- 模型推理:训练好的模型投入实际应用,对新的输入数据做出预测或决策,即为推理。虽然单次推理的计算量远小于训练,但在实际场景中(如每天处理数亿次的图片识别请求),需要高并发、低延迟地处理。专用的推理加速卡(或GPU的推理模式)能够以高能效比提供强大的实时计算能力,确保AI应用流畅运行。

三、AI加速卡与计算机软件开发的深度协同

AI加速卡的强大硬件能力,必须通过软件栈才能被开发者便捷、高效地调用。这正是计算机软件开发的核心用武之地,两者共同构成了AI时代的“速度密码”。

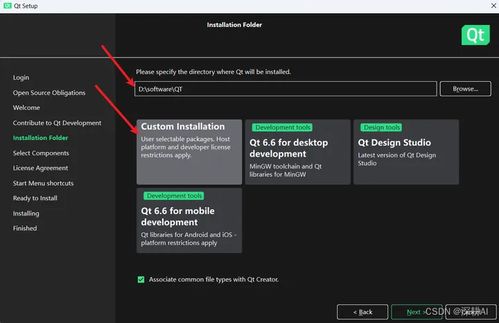

- 驱动与底层库:硬件厂商会提供核心驱动程序(Driver)和底层计算库(如NVIDIA的CUDA、AMD的ROCm、Intel的oneAPI)。这些软件层将加速卡的硬件功能抽象成编程接口,是硬件能力暴露给上层软件的基础。

- 高级框架与编译器:这是AI开发者的主要战场。主流的深度学习框架,如TensorFlow、PyTorch、PaddlePaddle等,其底层计算操作都通过调用CUDA等库,被映射到AI加速卡上执行。开发者使用高级Python等语言编写模型代码,框架和编译器则负责将其高效地编译、优化并调度到加速卡硬件上运行。软件开发者的任务,就是利用这些工具构建和优化AI模型。

- 模型优化与部署工具:为了进一步提升推理效率,软件开发还涉及模型优化技术,如量化(降低数值精度)、剪枝(移除冗余参数)、知识蒸馏等,并利用TensorRT、OpenVINO等部署工具包,将优化后的模型高效部署到各类AI加速卡甚至边缘设备上。

- 生态与云服务:成熟的软件开发生态至关重要。云服务商(如AWS、Azure、阿里云)提供集成了各种AI加速卡的虚拟机实例和容器服务,使开发者无需管理物理硬件,即可通过API和软件开发工具快速获取强大的AI算力,降低了AI应用开发的门槛。

四、展望与挑战

AI加速卡将继续朝着更高性能、更高能效、更专业化的方向发展。软硬件协同设计(Co-Design)将更加深入,新的编程模型、编译技术将持续涌现,以更充分地挖掘硬件潜力。对计算机软件开发而言,挑战在于如何更好地管理异构计算资源、设计更优的并行算法、以及构建更统一高效的软件栈,让开发者能更专注于AI算法和应用创新本身,而无需过度纠缠于底层硬件细节。

###

AI加速卡并非简单的“硬件升级”,它是为AI计算任务量身定制的“动力心脏”。而计算机软件开发则是驾驭这颗心脏的“神经系统”与“操作手册”。两者深度融合,共同破解了人工智能的“速度密码”,使得从前看似科幻的AI应用得以走进现实,持续推动着整个数字世界的智能化变革。对于开发者而言,理解AI加速卡的原理及其软件生态,已成为构建下一代智能应用不可或缺的核心技能。

如若转载,请注明出处:http://www.51qiangdiao.com/product/52.html

更新时间:2026-04-20 08:39:32